-

日期: 2026-02-01 | 來源: 智東西 | 有0人參與評論 | 字體: 小 中 大

Emu3與其他視頻擴散模型對比情況

Emu3可以通過預測未來幀來擴展視頻。以視頻擴展的定性為例,將2秒、24幀/秒的視頻token化為離散視覺token作為上下文。Emu3以同樣的離散視覺token形式預測後續2秒的內容,這些token可以被解token化以生成預測的未來視頻。

不同於Sora等模型的以噪聲為起點的擴散式視頻生成模型,Emu3通過自回歸方式逐token預測視頻序列,實現基於因果的視頻生成與延展,展現出對物理世界中環境、人類與動物行為的初步模擬能力。

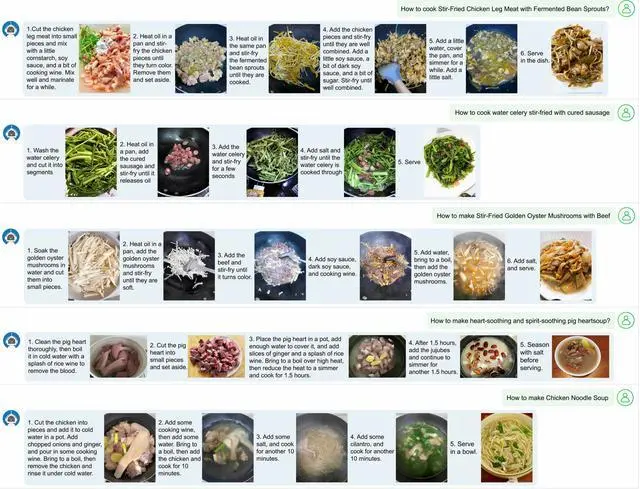

Emu3還可拓展至視覺語言交錯生成,例如圖文並茂的菜譜生成。

交錯圖文生成結果的可視化

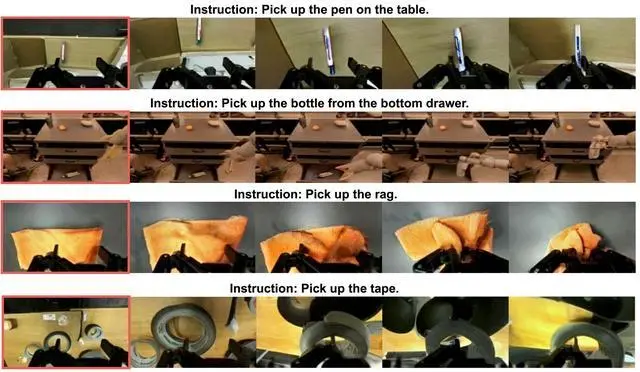

其也可拓展至視覺語言動作建模,如機器人操作VLA等,進壹步體現了“預測下壹個token”的通用性。

Droid數據集上視覺預測的可視化

事實上,在Nature論文之外,智源研究院於2025年10月30日發布了Emu3的後續版本Emu3.5,其在多種多模態任務上繼續展現出令人驚艷的效果以及SOTA的結果,對比Emu3有了全方位、大幅度的性能提升,開啟多模態世界大模型新紀元。

“悟界·Emu”系列在架構理念和實際效果上都達到了產品級,這才使它不僅在學術界獲得了《自然》期刊的高度認可,而且在業界引起了廣泛關注。Emu3及後續版本的成果具有重大產業應用前景,可能改寫整個多模態大模型格局,為中國在下壹代大模型下的原創科研成果樹立了典范。

叁、擴散模型已死?技術角度揭秘Emu3框架

Emu3及後續版本的發布,壹度在開發者社區引起討論和關注,甚至產生了“擴散模型已死”的說法。

對此,王仲遠坦言,目前對於擴散模型的研究趨勢尚不能定論。雖然有壹些成果如Emu3.5提供了世界模型的可行路徑,但並非唯壹路徑。未來可能會有更多技術路徑實現“預測下壹個狀態”,且擴散模型也在與其他技術結合改進。因此,不能斷言擴散模型會消失,而是需要持續觀察和學習交流。

盡管不能斷言自回歸路線已經壹統天下,但Emu3已經為產業提供了壹條新的康莊大道。

回到Emu3模型架構來看,其保留了Llama-2等成熟大語言模型的架構框架,主要修改在於擴展了嵌入層以容納離散的視覺標記。這是壹個統壹的、僅含解碼器的框架,該框架將語言、圖像和視頻建模為單壹的離散標記序列,並通過下壹個標記預測目標進行端到端訓練。

下圖展示了該框架,其方法包含伍個緊密集成的組件:- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見