-

日期: 2026-02-22 | 來源: 谷雨星球 | 有0人參與評論 | 字體: 小 中 大

康奈爾大學信息科學教授阿迪亞·瓦希斯塔,對於AI導致的同質化打了壹個比方:

「AI就像壹個老師,每次我寫作時都坐在我身後說,‘這是更好的版本’。通過這種日復壹日的接觸,你失去了你的身份,失去了真實性,也失去了對寫作的信心,變成了和AI壹模壹樣的人」。

上文提到的MIT的SAT寫作實驗也發現了同樣的趨勢。

當被問及「我們的成就必須有益於他人才能讓我們真正快樂嗎?」時,使用AI的參與者答案高度趨同,都集中在「職業和個人成功」上。

而面對關於慈善的提問,AI組的觀點驚人地壹致,全部支持,而其他組則出現了對慈善的批判性思考。

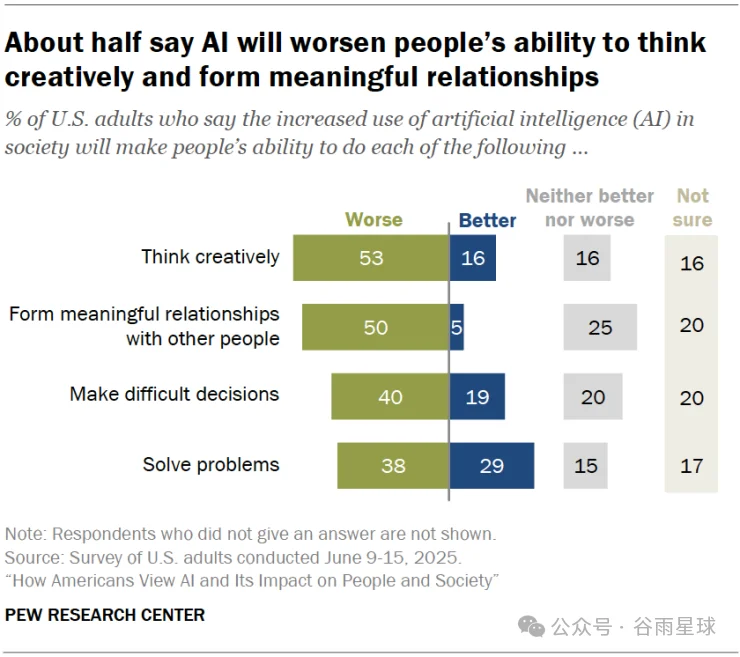

就像有人很早就預測過的,AI正在將我們拉向「思想的平均值」,它磨平了棱角,也抹去了個性。

更深層的風險在於,AI給的這些迅速的、全面的,甚至令人的答案,會讓我們對此上癮。

OpenAI與MIT媒體實驗室的研究發現,ChatGPT的重度用戶表現出明顯的過度依賴症狀,包括精神專注、戒斷反應、失控和情緒波動。

這些重度用戶往往更孤獨,也更容易在情感上依賴AI。

■越來越多孩子把AI當做親密的聊天伙伴,今年9月,美國聯邦貿易委員會要求包括OpenAI、Alphabet和Meta在內的柒家公司解釋他們的人工智能聊天機器人可能如何影響兒童和青少年,監管可能很快會跟上

把主動權搶回來

那麼,我們該如何避免被AI「吃掉」大腦?

答案或許很簡單:永遠不要在思考的起點就求助於AI。

無論是寫壹封郵件、構思壹個方案,還是解決壹個問題,先把你的第壹版想法寫下來,哪怕只是壹個很粗糙的初步構想。、

完成這個「從0到1」的「富有成效的奮斗」之後,再把AI請進來。

在之後的合作中,把它當作壹個不知疲倦的「陪練」或「審稿人」,不停問它:「我的邏輯鏈條有漏洞嗎?」「還有哪些我沒想到的角度?」「你能用更簡潔的語言表達我的第叁段嗎?」

這樣,你既完成了對大腦的鍛煉,又利用了AI的效率。你依然是思考的主人,AI只是你手中的利器,你的大腦依然安全。

- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見