-

日期: 2026-03-29 | 來源: DeepTech深科技 | 有0人參與評論 | 字體: 小 中 大

當我們觀察手機攝像頭時,你能清楚的看到玻璃保護層下的那組小鏡頭,沒了它手機就拍不了照。但是,如果把鏡頭拿掉,就剩壹塊光禿禿的芯片,它還能成像嗎?

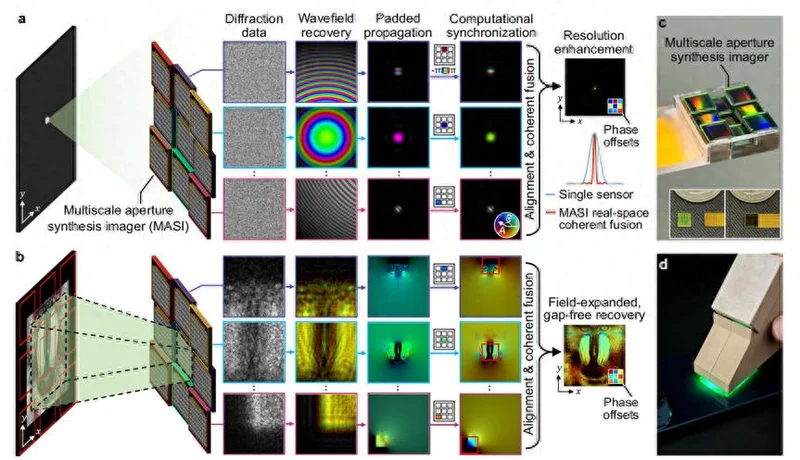

近日,美國康涅狄格大學的鄭國安教授團隊造出了壹台完全沒有鏡頭的相機,只用九塊小芯片拼在壹起,就能實現在厘米級工作距離下分辨亞微米的特征,而且成像視場比芯片本身大拾幾倍。

這台成像系統叫 MASI,全稱是多尺度孔徑合成成像儀。

(來源:https://www.nature.com/articles/s41467-025-65661-8)

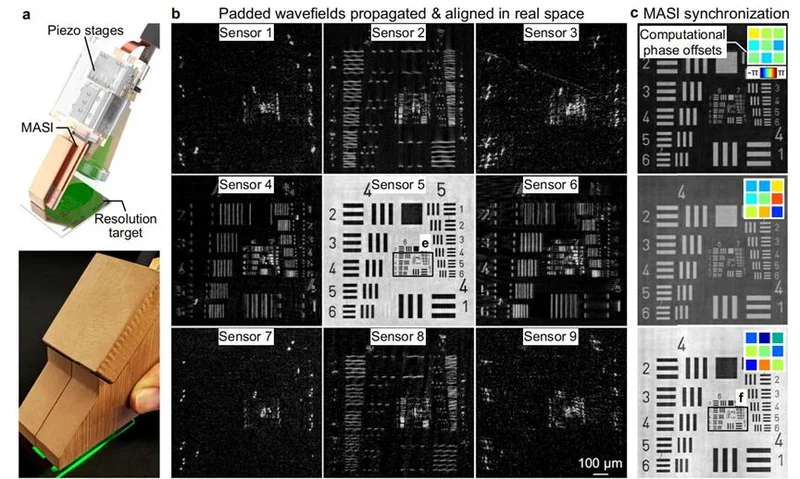

鄭國安告訴 DeepTech:“從分辨率角度講,我們實現了使用多個傳感器來突破單個傳感器的物理極限。我們用九個傳感器合成之後,在 2.2 厘米的工作距離上分辨出了 780 納米線寬。這在常見光學成像方案中非常難做到,要分辨這麼小的細節,通常得把物體放得非常靠近光學系統或顯微鏡。”

有了這項技術,在工業檢測上能在遠距離分辨微米級瑕疵;若進壹步小型化,有望用於手術器械,穿過狹小通道看到體腔深處。

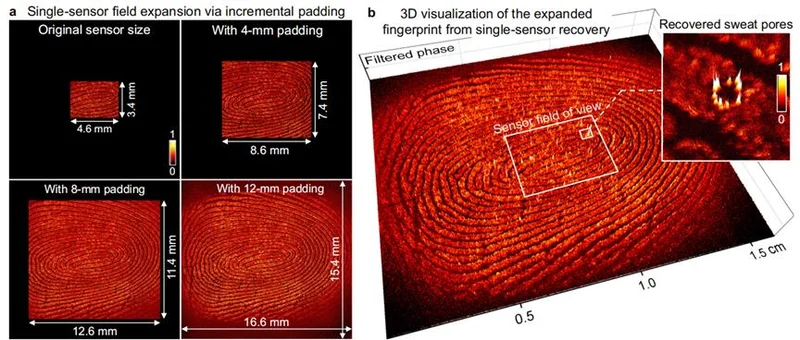

他們團隊用 MASI 拍了壹個人的指紋,單個傳感器的尺寸只有 4.6 乘以 3.4 毫米,只能拍到指紋的壹小部分。但是,他們通過計算場擴展的方法,把芯片捕捉到的光波信息往肆周數字外推,再反向傳播回物體平面,由原本單個芯片采集到的壹小部分信息,最終擴展出了壹張 16.6 乘 15.4 毫米的完整指紋圖,成像面積擴大了 16 倍,指紋上的脊線和汗孔都看得壹清贰楚。

(來源:https://www.nature.com/articles/s41467-025-65661-8)

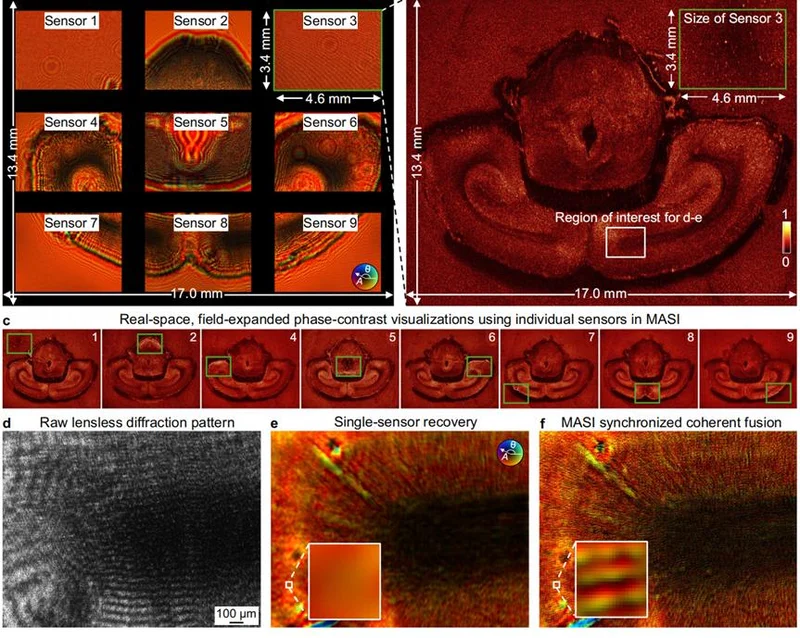

他們團隊還用 MASI 拍了壹塊小鼠腦組織切片,九塊芯片各自只拍到壹小塊區域,通過計算場擴展的方法拼起來之後整個腦切片的神經纖維走向壹覽無余,連從腦室向外放射的髓鞘軸突束都清晰可見。

(來源:https://www.nature.com/articles/s41467-025-65661-8)

在反射模式下,他們用這套系統拍了壹張標准分辨率測試卡,工作距離拉到 2.2 厘米,單塊芯片只能看清 2.19 微米的線條,而九塊芯片同步後能看清 780 納米的線條,要知道這已經達到了亞微米尺度的特征分辨能力。傳統光學顯微鏡要達到這個分辨率,通常需要把鏡頭懟到樣品壹毫米以內,MASI 卻在兩厘米開外就做到了。

(來源:https://www.nature.com/articles/s41467-025-65661-8)

MASI 還能用來做 3D 成像。他們拍了樂高積木上的凸起字母、硬幣上的浮雕花紋、電池表面的細微紋理,全都能變成 3D 圖像。值得壹提的是,他們把壹個子彈殼放在光路裡,MASI 拍下光波後,計算機在數字空間裡把波面壹層壹層往後推,每壹層都能算出哪部分最清晰,最後合出壹張 3D 高度圖。子彈殼上撞針留下的凹坑和精細的表面紋路,照樣被完整還原出來。

(來源:https://www.nature.com/articles/s41467-025-65661-8)

鄭國安告訴 DeepTech:“子彈發射時撞針會在彈殼上留下壹個凹槽,根據這個凹槽可以追蹤子彈和槍支的關系。我們精確重構出了這個凹槽,這對法醫學應用很有價值。也可以用在工業檢測上,比如測量發動機外表面的精確叁維結構。”

MASI 的原理說起來有點反常識:光從物體表面彈出來之後在空中自由傳播,本來應該越散越開、越變越模糊。但 MASI 恰恰利用了這種擴散,散開的光波裡藏著物體的完整信息,只要有足夠的算力把它還原回來,模糊反而成了優勢。九塊小芯片各自捕捉壹小部分散開的光,經過計算相位同步後,將各個芯片恢復的復波場在物平面相幹疊加,得到高分辨率重建。

研究中,他們用了壹個叫計算相位同步的方法來拼圖,每塊芯片在記錄光的時候會有壹個隨機的相位偏移,就像幾個人用不同的手表對時間,每只表快慢都不壹樣。

MASI 先指定壹塊芯片當基准,然後讓計算機自動算出其他八塊芯片應該調整多少相位差,才能讓所有光波在重建時步調壹致地疊加起來。這個過程不需要任何重疊的拍攝區域,也不需要參考光,純粹靠算法把九路信號對齊。

鄭國安團隊的這項技術,其實是在模仿射電望遠鏡的做法。2019 年拍下第壹張黑洞照片的事件視界望遠鏡,就是用分布在全球各地的射電望遠鏡同步接收信號,再通過算法合成壹張大圖。

鄭國安告訴 DeepTech:“黑洞那張照片其實不是用望遠鏡拍出來的,而是把分布在地球各地的好幾台射電望遠鏡連在壹起,相當於造了壹台地球那麼大的虛擬望遠鏡。這個技術叫合成孔徑技術,簡單說就是讓很多個小鏡頭合作起來,做到只有大鏡頭才能做到的事。”

而 MASI 把同樣的思路搬到了光波段,只不過射電望遠鏡用的是原子鍾來同步時間,MASI 用的是計算機來同步相位。

MASI 的妙處在於,它把最難的硬件問題變成了軟件問題,不需要精密的光學元件,不需要復雜的幹涉儀,不需要嚴格對齊的鏡片,只需要壹塊普通圖像傳感器加上壹層預先刻好的編碼表面,再用計算機把九塊芯片的數據拼起來,就能突破單塊芯片的物理極限。

普通的圖像傳感器只能探測到光的強度,就是每個像素上打了多少光子,探測不到光的相位,也探測不到光是從哪個方向來的。

“我們在圖像傳感器表面添加了壹層特殊設計的編碼圖案,有了這層圖案,就可以從單純的亮度信息裡把相位和方向信息反推出來。這就是為什麼我們能同時重構強度和相位,也是為什麼能用來做合成孔徑成像,因為合成孔徑成像必須用到相位信息。”鄭國安說。

如前所述,由於分布式傳感器陣列對安裝對准的要求更低,這種技術能用在很多地方,未來可探索在復雜形狀表面部署。

他們還在論文裡提到壹個有意思的應用,因為傳感器尺寸很小,而最終成像區域遠大於傳感器本身,所以可以把保密信息藏在傳感器的視野之外,從原始數據裡根本看不出這些信息存在,只有知道正確計算參數的人才能把它還原出來,這相當於壹種物理層面的加密。

圖 | 鄭國安教授(來源:受訪者)

談及商業化事宜,鄭國安表示:“我們的技術已經授權給了壹家公司,他們負責創業和商業化。我主要精力還是放在從零到壹的研究上,我和團隊的後續計劃主要放在遠距離合成孔徑上。這個項目的思路最初來自事件視界望遠鏡,現在做出了這樣壹套無透鏡成像系統,未來也是想把它用回到天文觀測上,合成壹個大的孔徑去看那些遙遠的星體。”

參考資料:

https://www.nature.com/articles/s41467-025-65661-8- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見