-

日期: 2026-04-13 | 來源: MIT科技評論 | 有0人參與評論 | 字體: 小 中 大

如果你今天問任何壹個 AI Agent:“昨天你幫我做了什麼?”不用說,它大概率會“壹臉茫然”,然後開始胡言亂語。

這是因為絕大多數基於 LLM 的智能體都受困於“無狀態困境”(Stateless Dilemma):會話壹旦結束,記憶即刻清零。下壹次對話,永遠是從零開始的冷啟動。你反復解釋過的項目背景、合作伙伴的性格偏好、你曾經表達過的觀點,對 Agent 而言都是壹片虛無。這也是阻擋 Agent 從“好用的工具”進化為“真正的助手”的障礙之壹。

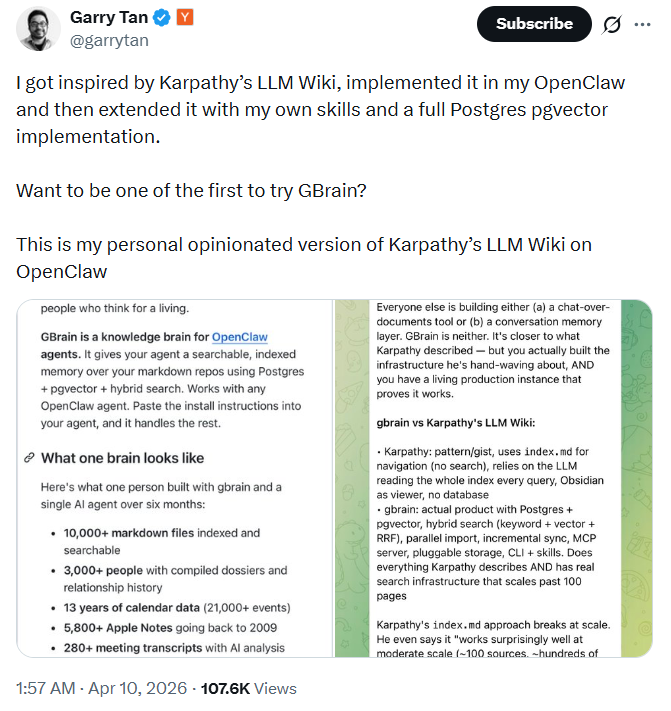

近日,Y Combinator(以下簡稱 YC)總裁兼 CEO Garry Tan 宣布將自己日常使用的個人知識系統 “GBrain” 開源。他在 X 上寫道:“我希望所有人都能擁有自己的‘個人迷你AGI’。”截至目前,該項目在 GitHub 上已獲得超過 5,000 顆星。

這並非 Garry Tan 近期的唯壹動作。壹個月前,他發布的基於 Claude Code 的結構化提示詞工作流 gstack 曾在壹周內斬獲超 69,000 顆 Star。盡管有人批評那“本質上只是文件夾裡的壹堆提示詞”,但此次推出的 GBrain 瞄准的是壹個更底層、更核心的問題:不僅要讓 Agent 更好地執行單次任務,更要賦予其持續積累、不斷進化的長效記憶。

按照 GBrain 的 README 文檔描述,整個系統的核心思路可以用壹句話概括:讓 Agent 經歷讀取—對話—寫入的閉環。

每當有新信號進入系統:可能是壹封郵件、壹段會議錄音、壹條推文,甚至是日歷上的某個行程變動……Agent 會先查詢已有知識庫(讀取),在充分理解上下文之後作出回應(對話),然後將這次交互產生的新知識寫回知識庫(寫入),供下壹次查詢使用。

Tan 在文檔中把這稱作“大腦-Agent 循環”,他認為這個循環的意義在於:每走壹圈,Agent 就比上壹圈更懂你。

這套循環到底解決什麼問題?可以設想壹個具體場景。作為 YC 的 CEO,Tan 每周可能要與數拾位創始人、投資人和合作伙伴打交道。假設他周贰下午和某位創始人開了壹場產品評審會,會議錄音被自動轉錄後流入 GBrain,Agent 會做幾件事:首先識別出會議中提到的所有人名和公司名(實體檢測),然後去知識庫查找這些人和公司是否已有對應頁面。

如果已有,比如這位創始人叁個月前在另壹場會議上已經見過。Agent 就把新的會議要點追加到那個人的時間線裡,同時更新頁面頂部的綜合判斷:這個人目前在做什麼、關心什麼、上次和你討論過什麼。如果是第壹次出現的陌生面孔,Agent 則會創建新頁面,並通過 Web 搜索、LinkedIn 數據、甚至 X 上的公開發言來填充背景資料。

這樣壹來,兩周後當 Tan 再次見到這位創始人時,他不需要翻郵件、查日歷、回憶上次聊了什麼。Agent 已經把所有上下文打包好了。

這種能力在處理復雜檢索時尤為顯著。例如,當你詢問“去年 3 月那次晚宴都有誰參加”時,傳統方式需要手動拼湊日歷、郵件和聊天記錄;而在 GBrain 體系下,由於每次交互都已被結構化並關聯至對應人物頁面,查詢可快速返回完整名單。

簡言之,GBrain 解決的核心痛點是:讓每壹次對話都建立在過往所有積累的基石之上,而非每次都從零開始。

- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見