-

日期: 2024-01-06 | 來源: 壹條 | 有0人參與評論 | 字體: 小 中 大

後來在日本,這個技術也被用來造黃謠,有年輕人通過換臉技術,出售偽造的不雅影片。再後來,就開始出現電話語音詐騙,還有我們看到的更高級的換臉變身詐騙。其實壹直到2022年,AI詐騙才開始集中大量出現。

▲

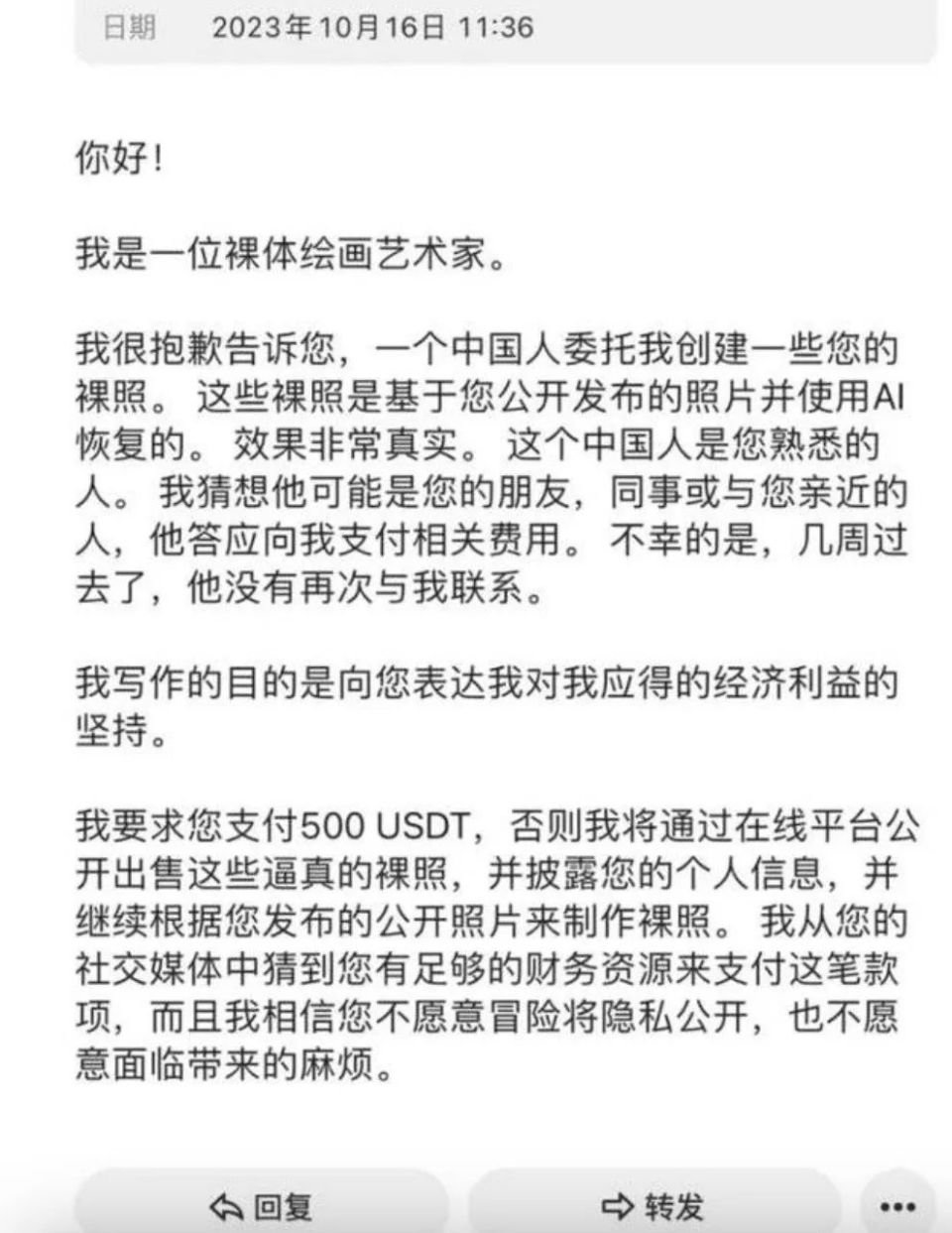

去年10月,壹位自稱裸體繪畫藝術家的人稱自己受到委托,按要求制作某博主的裸體圖片,因委托人沒有付費,所以他向博主索要500 USDT(加密貨幣,約合人民幣3500元),否則自己將會公開出售其裸照

Q:AI詐騙爆發有哪些原因?

A:在早期,硬件設施還不是非常完善,deep fake也有壹定技術門檻,需要有壹點代碼能力的人才會去使用。所以AI詐騙沒有那麼猖獗。2023年,被稱為“AI元年”,讓人驚歎的chatgpt也出現了,可以說AI技術突飛猛進,加上這幾年計算機硬件革新,算力大幅提升,讓能使用deep fake的硬件比較容易獲得。

而且,這項技術是開源的,比較容易獲取。在專業的軟件網站、應用商店,甚至網購平台就能找到。任何人都可以下載、學習和使用。

而且經過不斷的優化整合,現在的技術壁壘越來越低。比如說在網上,有些人會出售“壹鍵安裝包”,讓普通小白壹鍵安裝後就能使用。甚至在某些渠道,你花幾塊錢就能找人幫做壹條換臉視頻,所以主要是因為AI技術的學習、獲取門檻越來越低,導致AI詐騙的門檻也越來越低。

▲

圖片來源:petapixel

Q:AI詐騙常見的壹些方式和手段包括哪些?

A:首先就是語音詐騙,比如通過壹些唱歌、配音軟件提取你的聲音,通過騷擾電話來提取你的聲音,進行後期合成。還會通過盜號,用壹些第叁方的插件,實現語音轉發,獲取你的聲音樣本,再電話詐騙。

如果要更高階壹些,他們還會通過遠程控制軟件,向指定的目標人發送含有惡意軟件的鏈接或者文件,壹旦你打開,它就可能去控制你手機上的壹些APP,甚至盜取你的賬號密碼、個人身份信息等等,獲取你的聲音和照片,再去了解你的生活,找到你熟悉的親人、朋友,直接打視頻過去,進行詐騙。

- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見