-

日期: 2024-03-18 | 来源: 腾讯科技 | 有0人参与评论 | 字体: 小 中 大

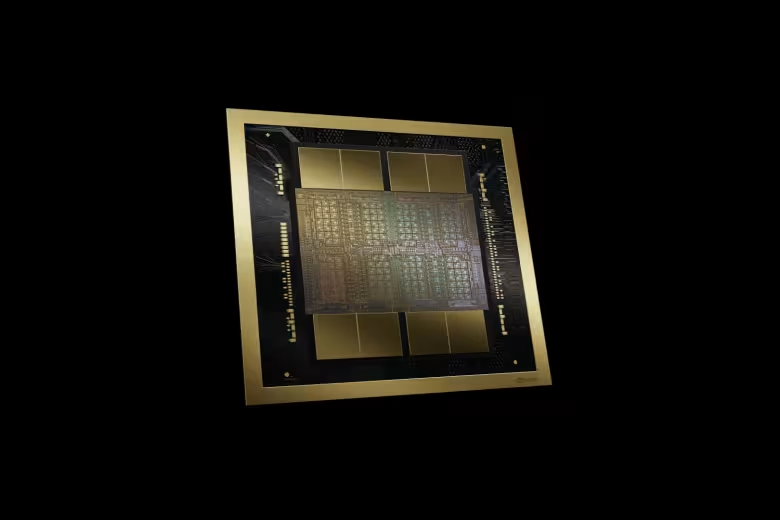

黄仁勋展示Blackwell和Hopper架构GPU对比,左边为Blackwell架构的B200芯片

在新一代的GPU正式亮相之前,关于架构、双芯片设计等已经有不少传闻,关注点在于,黄仁勋会把手中的“AI核弹”性能提升到多少?

现在,官方的答案给出来了——基于Blackwell架构的B200采用双芯片设计,基于台积电4nm工艺,晶体管数量达到2080亿个,上一代Hopper架构的H100同样是4nm工艺,但由于没有上双芯片设计,晶体管数量只有800亿。

B200搭配8颗HBM3e内存(比Hopper架构的H200多了2颗),内存达到192GB,基于第五代NVLink,带宽达到1.8TB/s,相比Hopper架构和Ampere架构,有了巨幅提升,最大可支持10万亿参数的模型的训练。

作为对比,OpenAI的GPT-3由1750亿个参数组成,GPT-4参数为1.8万亿。

B200官方图

黄仁勋还介绍称,B200平台可以向下兼容,支持与上一代Hopper架构的H100/H200HGX系统硬件适配。

此前,被称之为OpenAI劲敌的InflectionAI,官宣建立了一套22000颗英伟达H100GPU的世界最大人工智能数据中心集群,接下来要看看OpenAI,能不能借助B200反超了。

这里再插一句英伟达的NVLink和NVLinkSwitch技术。

其中NVLink是英伟达开发的CPU和GPU之间高速互联通道,在内存墙无法突破的情况下,最大化提升CPU和GPU之间通信的效率,于2016年在基于Pascal架构的GP100芯片和P100运算卡上率先采用,当时的带宽为160GB/s,到H100采用的第四代NVLink,其带宽已经达到900GB/s,而B200采用的第五代NVLink带宽已经突破1.8TB/s。

NVLinkSwitch支持与多个NVLink连接,实现NVLink在单节点、节点之间互联,进而创建更高带宽的GPU集群,基于最新的NVLinkSwitch芯片(台积电4nm工艺,500亿个晶体管),可实现576颗GPU组成计算集群,上一代产品仅支持到256个GPU。

根据官方公布的数据,B200支持第二代Transformer引擎,Tensor核支持FP4、FP6精度计算,单颗B200GPU的AI性能达20PFLOPs(即每秒2亿亿次)。

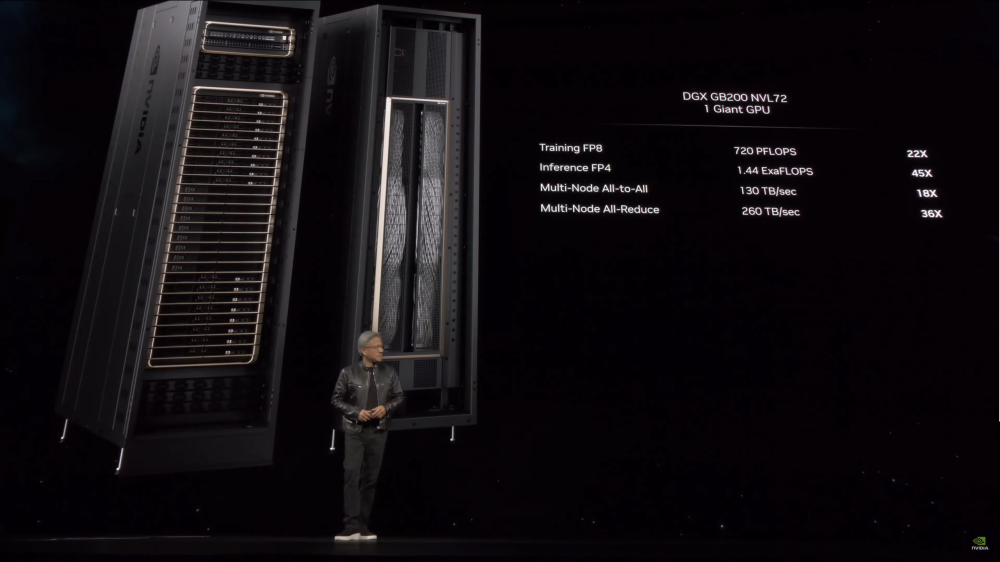

DGX版GB200NVL72

另外,英伟达还在主题演讲中展示了全新的加速计算平台DGXGB200NVL72,拥有9个机架,总共搭载18个GB200加速卡,即36颗GRACECPU和72颗Blackwell架构GPU(英伟达也提供了HGXB200版本,简单来说就是用Intel的XeonCPU,替换了GraceCPU)。

黄仁勋说,一套DGX版GB200NVL72总共内置了5000条NVLink铜制线缆,总长度达到2公里,可以减少20kW的计算能耗。- 新闻来源于其它媒体,内容不代表本站立场!

-

原文链接

原文链接:

目前还没有人发表评论, 大家都在期待您的高见