-

日期: 2026-04-29 | 來源: 量子位/智東西 | 有0人參與評論 | 專欄: 騰訊 | 字體: 小 中 大

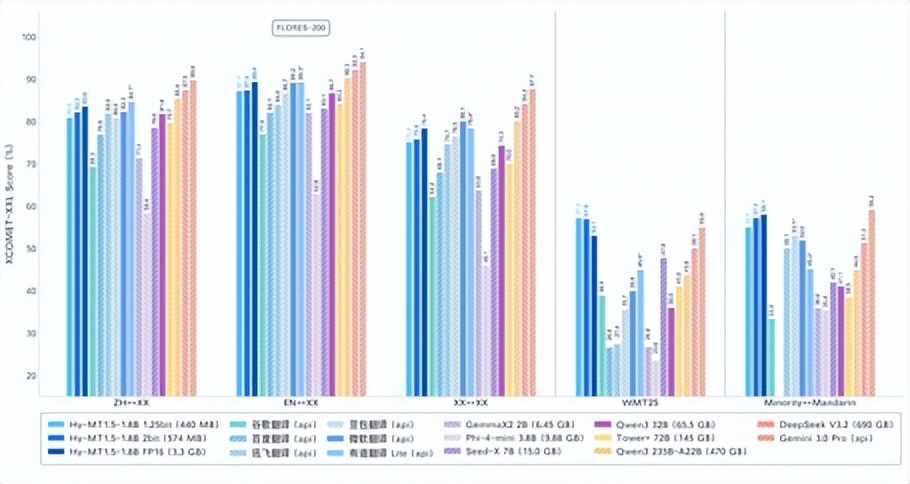

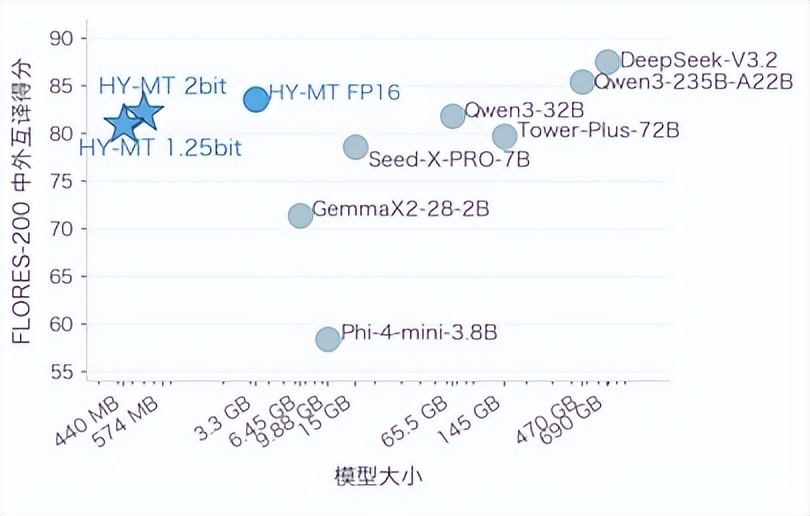

4月29日,騰訊混元推出並開源極致量化壓縮版本翻譯模型 Hy-MT1.5-1.8B-1.25bit,把支持 33 種語言的翻譯大模型壓縮至 440MB,無需聯網,下載即可直接在手機本地運行,翻譯質量優於谷歌翻譯。

翻譯質量及速度演示(設備:高通驍龍 865 8GB 內存)

這壹離線翻譯模型基於混元翻譯大模型Hy-mt1.5打造 。Hy-mt1.5 是騰訊混元團隊打造的專業翻譯大模型,原生支持 33 種語言、5 種方言/民漢及 1056 個翻譯方向。從常見的中英互譯,到法語、日語、阿拉伯語、俄語,甚至藏語、蒙古語等少數民族語言,它都能游刃有余地處理。

值得注意到是,僅以 1.8B 參數量,Hy-mt1.5 實現了比肩商業翻譯 API 和 235B 級大模型的翻譯效果 。在嚴格的評測基准中,其翻譯質量不僅超越了 Google 翻譯等主流系統,更證明了在高效優化下,輕量級模型能夠展現出亮眼的翻譯能力。

在實際業務場景中,混元團隊發現,原始的 1.8B 模型即使在 FP16 精度下,依然占用 3.3GB 內存,對於手機上金子般珍貴的內存來說,依然太大、太慢,所以需要量化壓縮。

所謂的量化壓縮,就是通過把模型裡原本用16位數字(16-bit)表示的參數轉用更低位數字儲存,這就像把壹幅高清照片壓縮成縮略圖,文件小了很多,但你還是能看清楚裡面的內容。 針對不同的手機用戶, 騰訊特別推出了2-bit 與 1.25-bit 兩種極致的量化壓縮方案。

2-bit模型在 SME2 及 Neon 內核的速度對比演示。

- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見