-

日期: 2024-04-04 | 來源: 硅星人 | 有0人參與評論 | 字體: 小 中 大

如果讓你在互聯網上給大模型選壹本中文教材,你會去哪裡取材?是知乎,是豆瓣,還是微博?壹個研究團隊為了構建高質量的中文指令微調數據集,對這些社交媒體進行了測試,想找到訓練大模型最好的中文預料,結果答案保證讓你大跌眼鏡——

弱智吧。

弱智吧是百度貼吧上的壹個子版塊,這是壹個非常神奇的地方,吧友們熱衷於創作和分享壹語雙關、壹詞多義、因果倒置、諧音梗等帶著邏輯陷阱的內容,而且部分帖子甚至帶有壹定的哲學意味。但是,拿這些東西訓練全知全能偉大的大模型?能行嗎。

別急,我們先來看看這個研究團隊做了什麼實驗。

這是壹篇題為《COIG-CQIA: Quality is All You Need for Chinese Instruction Fine-tuning》的論文,作者來自多個國內外高校,簡單來說,他們提出了壹個中文指令微調數據集COIG-CQIA(全稱為Chinese Open Instruction Generalist-Quality Is All You Need )。

對於中文大模型開發者來說,目前的壹個重點挑戰就在於沒有壹個高質量中文數據集,研究團隊認為,各種中文社交媒體、論壇對於大模型的訓練應該是很好的語料來源。

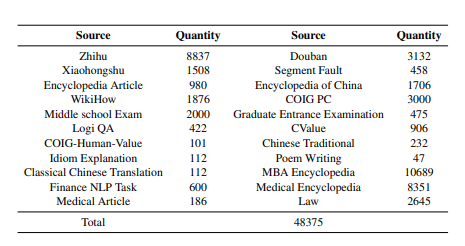

於是為了給這個數據集取材,他們從不同的社交平台(如問答社區、維基百科、考試材料、已有的 NLP 數據集等)收集了高質量的人工編寫的文本集合,這些文本經過嚴格篩選和細致處理,最終才構建出了這個數據集。

論文稱,這個數據集的目的是構建壹個多樣化、廣泛的服務於中文大模型的指令調優數據集,以更好地使模型行為在中文環境下與人類互動相壹致,提高指令響應的能力。

這裡也科普壹個概念,那就是大模型雖然有強大的知識儲備,但是它是為解決通用自然語言處理任務而設計的,因此沒有辦法處理特定問題。此時,就需要對其進行“微調”,來讓其輸出結果符合特定問題的預期。而指令微調就是說明確了模型應執行的任務類型、輸入要求、輸出格式等具體細節情況下,再給出正確的結果。比如我用中文提問,並要求模型用西班牙語回答,那麼模型的開發者為了滿足我後半句話的要求,就得對模型進行指令微調。

這時就需要壹個“指令微調數據集”。這類數據集通常包含大量的“指令-輸出”對,其中每個對包括壹個明確的指令(instruction),即用戶希望模型執行的任務說明,以及與之對應的理想輸出(output),即模型在接收到該指令後應當生成或執行的結果。

COIG-CQIA就是這樣壹個數據集。研究團隊首先是對數據集進行了嚴格的篩選和清洗,確保數據集是比較健康的。具體做法是根據預設的篩選標准,去除無關或低質量的文本。這可能包括刪除廣告、無意義的灌水內容、含有敏感信息或違反社區規則的帖子等。

之後,團隊還做了人工幹預:對處理後的文本進行人工審核,確保其內容正確無誤,符合預期的語義和知識標准,同時也確保數據集與真實的中文用戶交互模式相壹致。尤其是在壹些諸如弱智吧語錄這樣深層隱喻比較強,模型基本沒辦法完全理解采集到的段子的含義,那就需要進行人工標注,提供明確的指令-輸出示例,為模型微調提供精確的訓練信號。- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見