-

日期: 2023-12-07 | 來源: 侃英語 | 有0人參與評論 | 字體: 小 中 大

年終歲末,到了各家詞典盤點年度詞匯的時候,我自己平時經常查詢的肆大權威詞典,給出了他們的選擇:

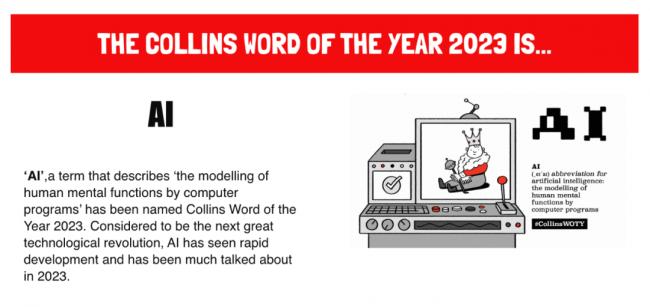

1.柯林斯詞典:AI

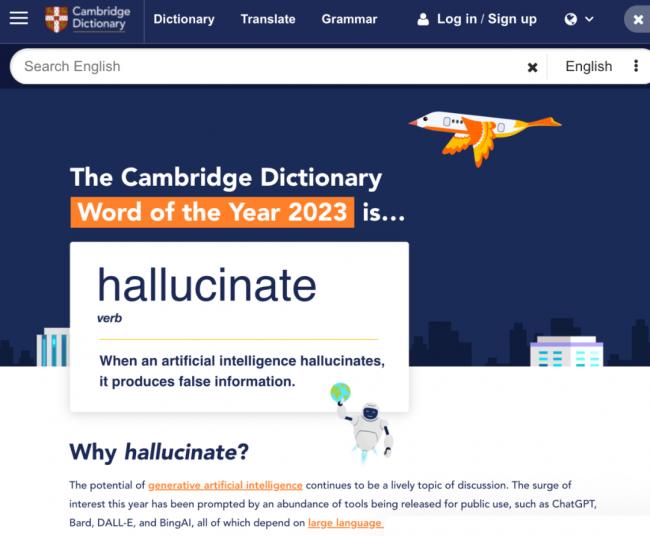

2.劍橋詞典:hallucinate

3.韋氏詞典:Authentic

4.牛津詞典:rizz

下面侃哥盤點壹下這些詞典的盤點:

1.《柯林斯詞典》評選的2023年度詞匯是——AI

AI 是Artificial Intelligence(人工智能)的首字母縮寫。

詞典給出的理由是“Al has seen rapid development and has been much talked about in 2023(發展速度如此之快,並成為2023年的主導話題)”。

的確,2023年是人工智能爆發的元年,隨著 ChatGPT 的推出,幾乎人人都在聊。

其實“人工智能”很早以前就開始搞了,但 ChatGPT 的意義在於,它代表了“強人工智能”時代的到來,術語叫 Strong AI,或 Artificial General Intelligence(通用人工智能),機器通過學習能接近甚至超越人類的智能,從而解決任何問題。與之相比,以前的人工智能只能算“弱人工智能”,簡稱“弱智”。Image

可以預見,在不久的將來,AI 會像互聯網、電子郵件、流媒體壹樣,成為無處不在的技術,與人們的日常生活水乳交融。選擇這個詞作為2023年度詞匯非常合適。

2.《劍橋詞典》評出的詞是——hallucinate。

hallucinate /həˈluːsɪneɪt/ ,這是壹個動詞,表示“產生幻覺”,其名詞形式為 hallucination(幻覺)。

劍橋詞典的官網給 hallucinate 增加了壹個新的定義:When an artificial intelligence hallucinates, it produces false information(當人工智能產生幻覺時,它會產生錯誤的信息。)

好家伙,又是壹個跟 AI 相關的詞匯, 不過這個詞壹針見血地指出 AI 的壹個致命弊端。

詞典給出的這個例句很能說明問題:

LLMs are notorious for hallucinating C generating completely false answers, often supported by fictitious citations.

譯:“大型語言模型”以產生幻覺而聞名,即產生完全錯誤的答案,而且還被虛假的引用所支持。

無論 OpenAI 的ChatGPT、微軟的 BingChat、谷歌的 Bard 或百度的文心壹言,其本質都是“LLMs”(large language models,大語言模型),如果你使用過它們,就會發現壹個問題:它們在生成回答的時候,有時會“壹本正經地胡說八道”,甚至編造出壹些所謂的事實,這種情況就是 hallucinate。- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見