-

日期: 2024-03-13 | 來源: 量子位 | 有0人參與評論 | 字體: 小 中 大

OpenAI大模型加持的機器人,深夜來襲!

名曰Figure 01,它能聽會說,動作靈活。

能和人類描述眼前看到的壹切:

我在桌子上看到了壹個紅色的蘋果,瀝水架上面還有幾個盤子和壹個杯子;然後你站在附近,手放在桌子上。

聽到人類說“想吃東西”,就馬上遞過去蘋果。

而且對於自己做的事有清楚認知,給蘋果是因為這是桌上唯壹能吃的東西。

還順便把東西整理,能同時搞定兩種任務。

最關鍵的是,這些展示都沒有加速,機器人本來的動作就這麼迅速。

(也沒人在後面操縱)

這下網友坐不住了,立馬@波士頓動力:

老伙計們,這家伙是真來勁兒了。咱得回實驗室,讓以前的機器人(波士頓動力)多跳點舞了。

也有網友看在OpenAI卷完大語言模型、文生視頻之後,又狙擊機器人後感慨道:

這是壹場激烈的競爭;與OpenAl合作,蘋果可能會超越特斯拉。

但硬件方面,擎天柱看起來更美觀,Figure 01仍然需要壹些“整容手術”。(doge)

接下來,我們繼續來看下Figure 01的細節。

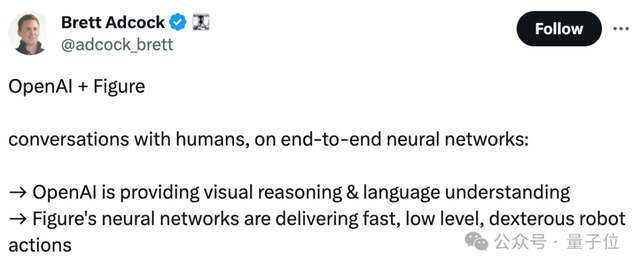

OpenAI視覺語言大模型加持

根據創始人的介紹,Figure 01通過端到端神經網絡,可以和人類自如對話。

基於OpenAI提供的視覺理解和語言理解能力,它能完成快速、簡單、靈巧的動作。

模型只說是壹個視覺語言大模型,是否為GPT-4V不得而知。

- 新聞來源於其它媒體,內容不代表本站立場!

-

原文鏈接

原文鏈接:

目前還沒有人發表評論, 大家都在期待您的高見